随机森林算法:原理、特点、训练和预测

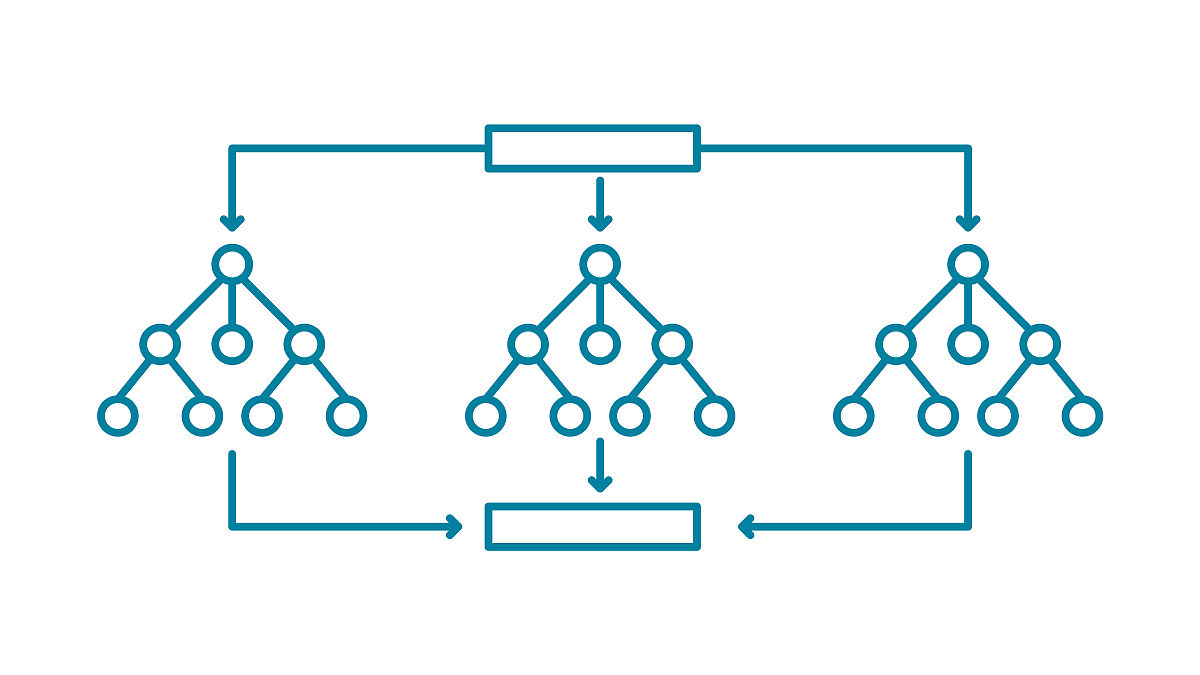

随机森林是一种集成学习算法,它通过构建多个决策树来进行分类和回归任务。以下是随机森林算法的详细介绍:

-

随机森林的原理:随机森林由多个决策树组成,每棵决策树都是独立构建的。随机森林通过对训练集进行有放回抽样(bootstrap sampling)生成多个不同的训练集,然后使用这些训练集构建多个决策树。在构建每棵决策树的过程中,随机森林会随机选择特征子集进行划分,以增加决策树之间的差异性。最后,随机森林通过投票或平均等方式来进行分类(对于分类问题)或预测(对于回归问题)。

-

随机森林的特点:

- 随机性:随机森林通过有放回抽样和特征子集的随机选择来引入随机性,使得每棵决策树都有所不同,提高了模型的多样性和鲁棒性。

- 高性能:随机森林能够处理高维数据和大规模数据集,并且在训练过程中能够并行化处理,提高了训练速度和性能。

- 鲁棒性:随机森林对于缺失值和异常值具有较好的鲁棒性,能够处理不平衡数据集和噪声数据。

- 可解释性:由于随机森林是由多棵决策树组成的,每棵决策树都可以提供特征重要性评估,能够解释输入特征对于预测结果的贡献程度。

-

随机森林的训练过程:

- 从原始训练集中使用有放回抽样的方式生成多个不同的训练集。

- 对于每个训练集,使用特征子集的随机选择来构建一棵决策树。

- 在构建决策树的过程中,根据某种准则(如信息增益、基尼指数等)选择最佳的特征和划分点。

- 重复以上步骤,构建多棵决策树。

-

随机森林的预测过程:

- 对于分类问题,随机森林通过投票的方式来确定最终的分类结果。每棵决策树给出一个分类结果,最终选择得票最多的类别作为最终预测结果。

- 对于回归问题,随机森林通过平均每棵决策树的预测结果来得到最终的预测值。

随机森林算法在实际应用中具有较好的性能和鲁棒性,广泛应用于分类、回归和特征选择等任务中。

原文地址: https://www.cveoy.top/t/topic/bDzB 著作权归作者所有。请勿转载和采集!