SparkSQL 数据导出为 CSV 文件指南

在 SparkSQL 中将数据导出为 CSV 文件可以通过以下步骤实现:

-

使用 SparkSession 对象创建 DataFrame,加载数据源文件。

-

使用 DataFrame 的 write 方法将数据写入 CSV 文件。

-

在 write 方法中使用 option 方法设置 CSV 文件的相关参数,如文件路径、分隔符等。

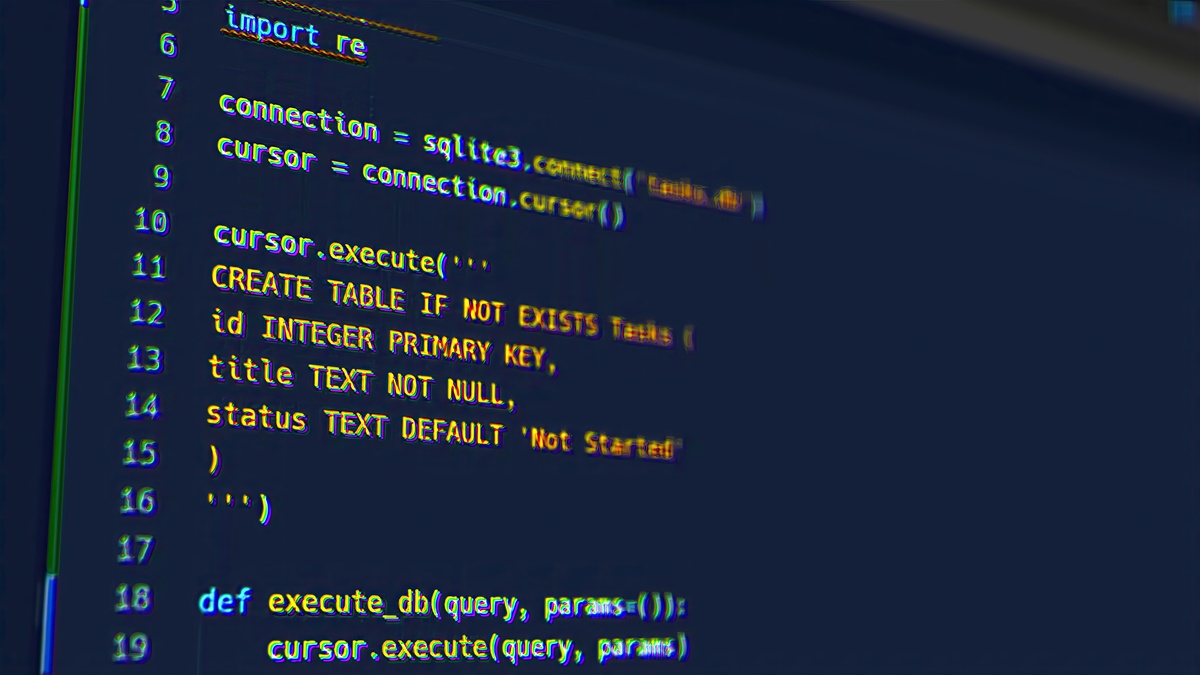

下面是一个示例代码:

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName('export_csv').getOrCreate()

# 加载数据源文件

df = spark.read.format('csv').option('header', 'true').load('path/to/source/file.csv')

# 写入 CSV 文件

df.write.format('csv').option('header', 'true').option('delimiter', ',').save('path/to/output/file.csv')

在这个例子中,首先使用 SparkSession 对象创建了一个 DataFrame,加载了数据源文件。然后使用 write 方法将数据写入 CSV 文件,并通过 option 方法设置了 CSV 文件的分隔符。最后,将 CSV 文件保存到指定路径下。

需要注意的是,写入 CSV 文件时需要指定文件的路径和文件名,并且需要确保写入的 CSV 文件在本地文件系统或者 Hadoop 文件系统中存在。

原文地址: https://www.cveoy.top/t/topic/oaqU 著作权归作者所有。请勿转载和采集!