OBGG 数据爬取与可视化设计:详细指南

OBGG 数据爬取与可视化总体设计与详细设计

总体设计

- 确定数据源: 确定需要爬取的数据源,可以是 OBGG 网站、API 接口或者其他数据集。

- 爬取数据: 使用爬虫技术从数据源中获取数据。可以使用 Python 中的库(如 Scrapy、BeautifulSoup 等)编写爬虫程序,根据需求进行数据的抓取和清洗。

- 数据存储: 将爬取到的数据存储到数据库中,可以选择关系型数据库(如 MySQL、PostgreSQL 等)或非关系型数据库(如 MongoDB)。

- 数据处理与分析: 对爬取到的数据进行处理和分析,提取有用的信息。可以使用 Python 中的数据处理和分析库(如 Pandas、NumPy 等)进行数据的清洗、转换和计算。

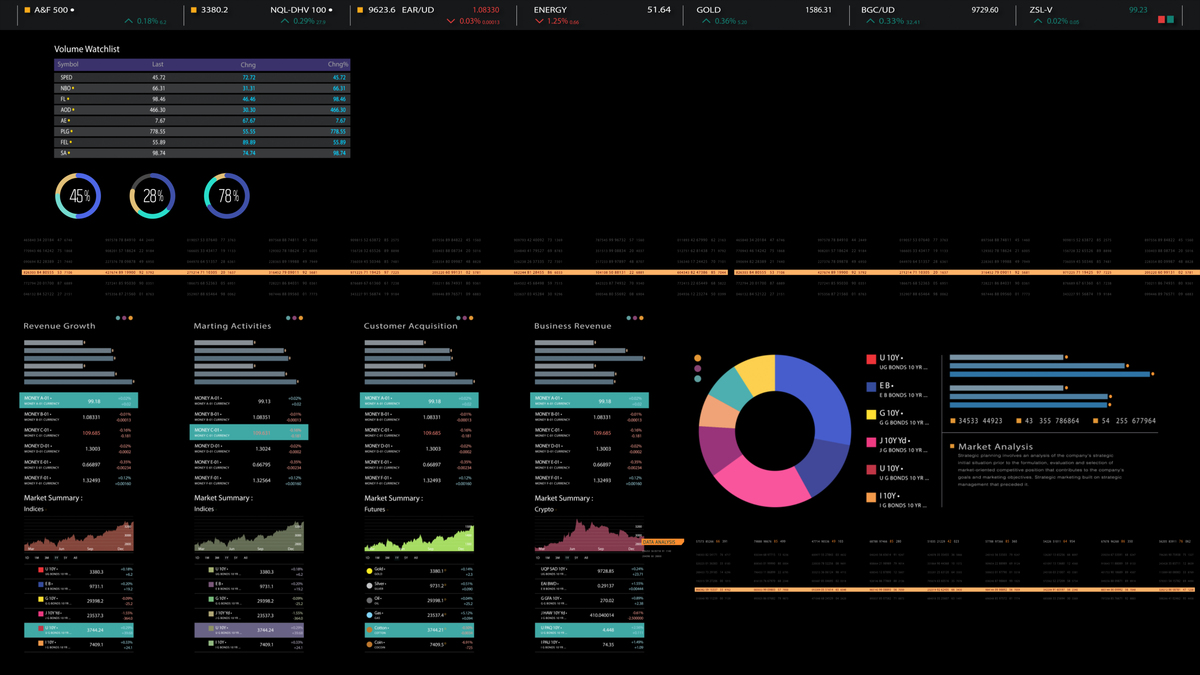

- 数据可视化: 使用数据可视化工具(如 Matplotlib、Seaborn、Tableau 等)对处理后的数据进行可视化展示,生成图表、图形或地图等形式的可视化结果。

详细设计

- 确定数据源: 根据需求确定需要爬取的数据源,可以是 OBGG 网站的特定页面、API 接口或者其他数据集。

- 爬取数据: 根据数据源的特点,选择合适的爬虫技术进行数据的抓取。可以使用 Scrapy 框架进行网页爬取,使用 Requests 库进行 API 接口爬取,或者使用其他爬虫工具进行数据的获取。

- 数据清洗: 对爬取到的数据进行清洗,去除重复数据、处理缺失值和异常值等。可以使用 Python 中的 Pandas 库进行数据的清洗和转换。

- 数据存储: 将清洗后的数据存储到数据库中,可以选择合适的数据库管理系统进行数据的存储和管理。可以使用 SQL 语句进行数据库的创建和表的设计。

- 数据处理与分析: 对存储在数据库中的数据进行处理和分析,提取有用的信息。可以使用 Python 中的 Pandas 库进行数据的处理和计算,使用统计方法进行数据的分析。

- 数据可视化: 根据需求选择合适的数据可视化工具进行可视化展示。可以使用 Matplotlib 库进行基本图表的绘制,使用 Seaborn 库进行统计图表的绘制,使用 Tableau 等工具进行交互式可视化展示。

- 用户界面设计: 根据需求设计用户界面,提供交互式的数据可视化功能。可以使用 Python 中的 GUI 库(如 Tkinter、PyQt 等)进行用户界面的设计和开发。

- 性能优化: 对爬取、处理和可视化过程进行性能优化,提高系统的运行效率和响应速度。可以使用多线程、分布式计算等技术进行并行处理,减少系统的负载。

- 安全性保障: 对数据的爬取和存储过程进行安全性保障,防止数据泄露和非法访问。可以使用数据加密、访问控制等技术进行数据的保护。

- 部署与维护: 将系统部署到服务器上,进行系统的监控和维护。定期更新数据,修复系统的漏洞和问题,保证系统的稳定性和可用性。

原文地址: https://www.cveoy.top/t/topic/o33S 著作权归作者所有。请勿转载和采集!