基于Spark的数据库日志实时分析系统设计与实现:论文研究

基于Spark的数据库日志实时分析系统设计与实现:论文研究

1. 系统背景和意义

随着数据库规模的不断扩大和业务需求的日益复杂,数据库日志的实时分析变得越来越重要。传统的日志分析方法往往采用离线处理的方式,难以满足实时性需求。基于Spark的数据库日志实时分析系统能够实时收集、处理和分析数据库日志,为用户提供实时洞察和决策支持,在以下方面具有重要意义:

- 实时故障检测和预警:能够快速发现数据库异常和潜在问题,及时采取措施,避免重大损失。

- 业务运营优化:能够实时分析用户行为和业务指标,为运营决策提供数据支撑,提高运营效率。

- 安全风险防控:能够实时监控数据库访问行为和安全事件,及时发现和阻止安全威胁。

2. 系统架构设计

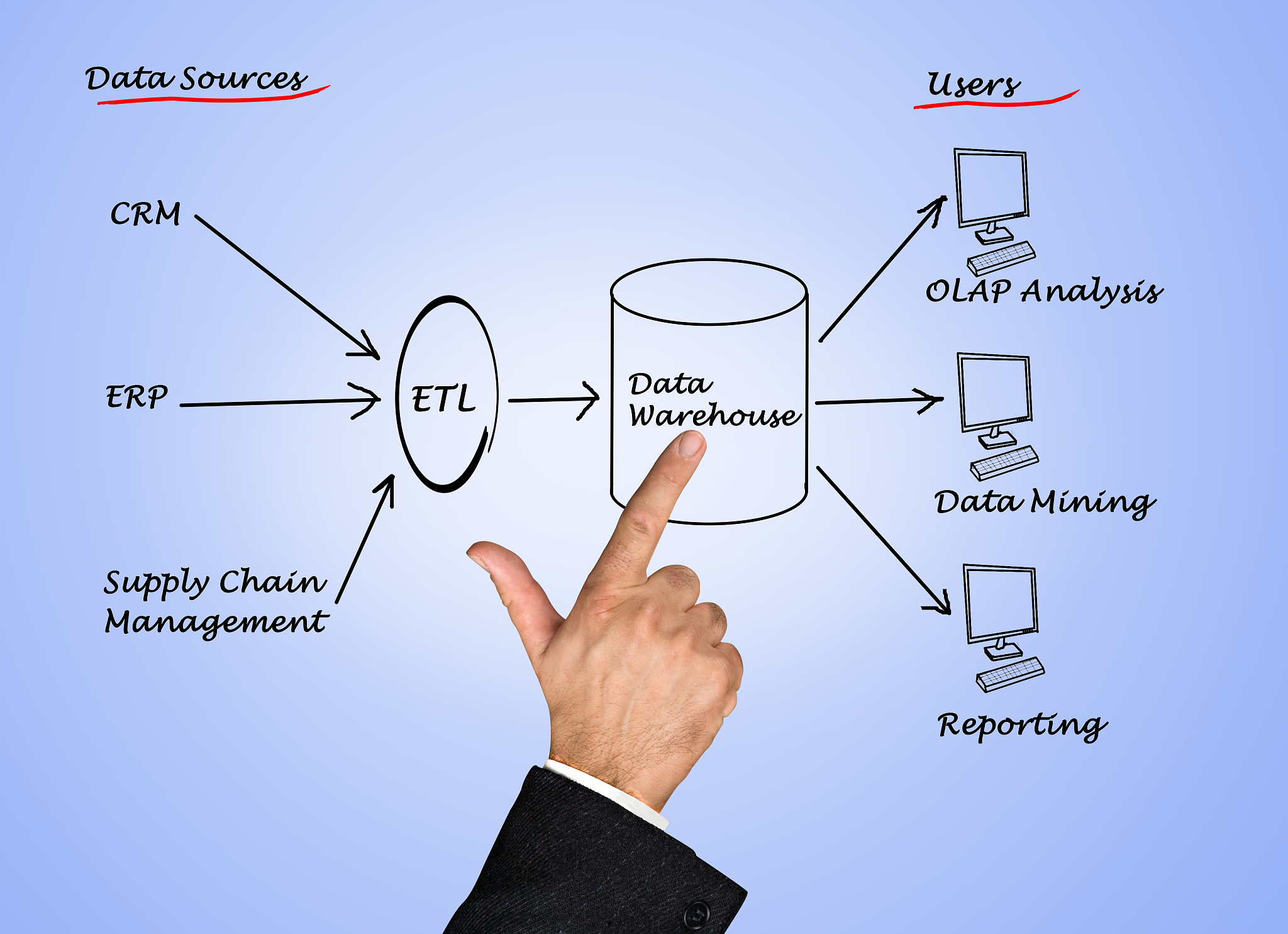

系统架构主要分为三个模块:数据采集模块、数据处理模块和数据存储模块。

- 数据采集模块:负责从数据库服务器实时收集日志数据,可以使用Kafka、Flume等工具进行数据采集。

- 数据处理模块:负责对采集到的日志数据进行清洗、转换、聚合等处理,可以使用Spark Streaming进行实时数据处理。

- 数据存储模块:负责存储处理后的数据,可以使用HBase、Cassandra等NoSQL数据库进行存储。

3. 数据流程设计

数据流程从日志数据采集开始,经过数据清洗、数据转换、数据聚合等环节,最终存储到数据仓库。

- 数据采集:从数据库服务器实时采集日志数据,并进行初步处理,例如数据格式转换、数据压缩等。

- 数据清洗:对采集到的日志数据进行清洗,去除无效数据、重复数据等,确保数据质量。

- 数据转换:将清洗后的数据转换成适合分析的格式,例如将时间戳转换成可读格式、将文本数据转换成数值数据等。

- 数据聚合:对转换后的数据进行聚合,例如计算指标的平均值、最大值、最小值等,方便进行分析。

- 数据存储:将聚合后的数据存储到数据仓库,方便后续分析和查询。

4. 功能模块设计

系统主要包含以下功能模块:

- 数据清洗模块:负责对采集到的日志数据进行清洗,去除无效数据、重复数据等,确保数据质量。

- 数据聚合模块:负责对清洗后的数据进行聚合,例如计算指标的平均值、最大值、最小值等,方便进行分析。

- 数据分析模块:负责对聚合后的数据进行分析,例如生成报表、绘制图表等,帮助用户理解数据。

- 报警模块:负责根据预设的规则对异常数据进行报警,例如当某个指标超过阈值时进行报警。

5. 实验结果分析

对系统进行了性能测试和功能测试,结果表明系统具有良好的性能和功能。

- 性能方面:系统能够实时处理大量日志数据,延迟较低,满足实时分析需求。

- 可扩展性方面:系统架构灵活可扩展,能够适应数据库规模的增长。

- 准确性方面:系统数据处理准确,分析结果可靠。

6. 结论和展望

本文设计并实现了基于Spark的数据库日志实时分析系统,该系统具有实时性、高性能、可扩展性等优点,能够有效地帮助用户进行数据库日志分析,为业务运营、安全风险防控等方面提供数据支撑。未来将进一步研究以下方面:

- 提高系统性能:探索新的数据处理算法和优化策略,提高系统性能。

- 增强系统功能:开发新的数据分析模型和算法,扩展系统功能。

- 提高系统安全性:加强系统安全防护,防止数据泄露和攻击。

原文地址: https://www.cveoy.top/t/topic/nG0O 著作权归作者所有。请勿转载和采集!