Python 爬虫入门指南:从基础到实战

Python 爬虫的基本流程如下:

-

确定目标网站,分析网站结构和数据获取方式。

-

选择适合的爬虫框架或库,如 Scrapy、BeautifulSoup、requests 等。

-

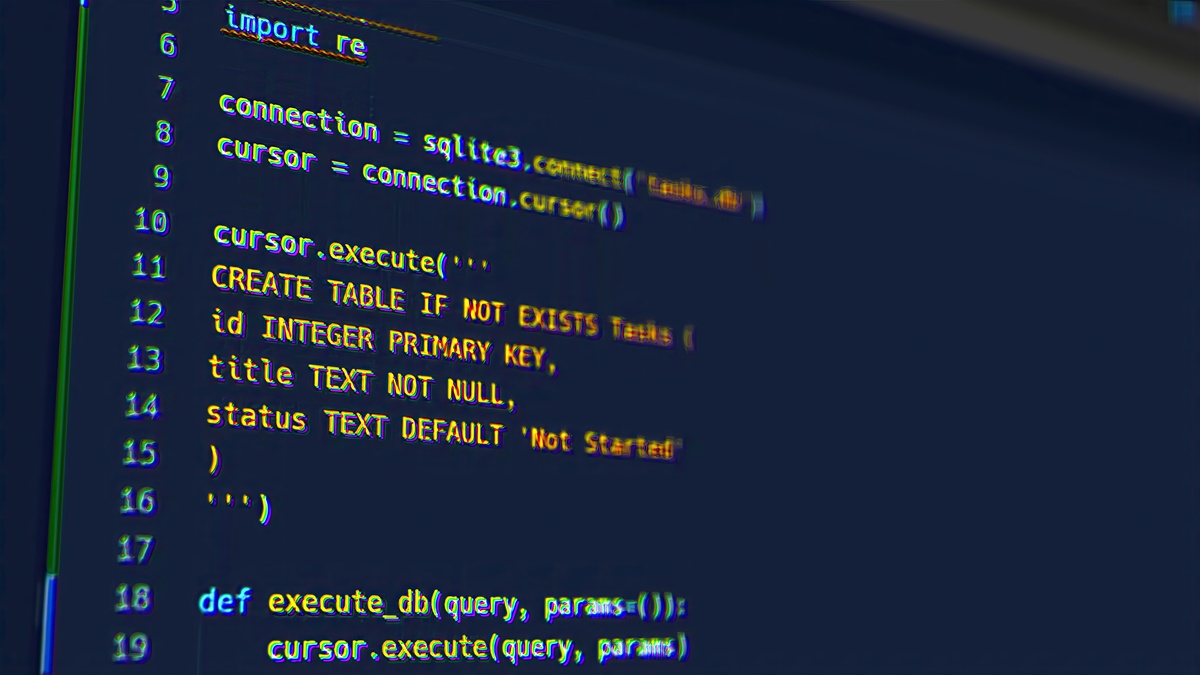

根据目标网站的结构和数据获取方式,编写爬虫程序,使用 HTTP 请求获取网页内容,解析 HTML 或 JSON 等格式的数据,提取所需信息。

-

存储数据,可以选择保存到本地文件或数据库中。

-

处理反爬机制,如设置请求头、使用代理 IP、使用验证码识别等。

-

定期更新爬虫程序,适应目标网站结构和数据获取方式的变化。

需要注意的是,在进行爬虫操作时,要遵守相关法律法规和网站的使用条款,不得进行非法、恶意的爬虫行为。

原文地址: https://www.cveoy.top/t/topic/mNY2 著作权归作者所有。请勿转载和采集!