Python爬虫技术入门:高效获取互联网数据

Python爬虫技术是利用Python编程语言来获取互联网上的数据的技术。它可以自动化地访问网页、抓取数据、解析数据,并将数据保存或进行进一步的处理分析。

Python爬虫技术的流程通常包括以下几个步骤:

-

发送HTTP请求:使用Python的网络库,如requests或urllib,发送HTTP请求到目标网站。

-

获取响应数据:获取服务器返回的响应数据,包括HTML、JSON、XML等。

-

解析数据:使用Python的解析库,如BeautifulSoup或lxml,对获取的页面进行解析,提取出需要的数据。

-

存储数据:将解析得到的数据保存到本地文件或数据库中,以便后续使用或分析。

-

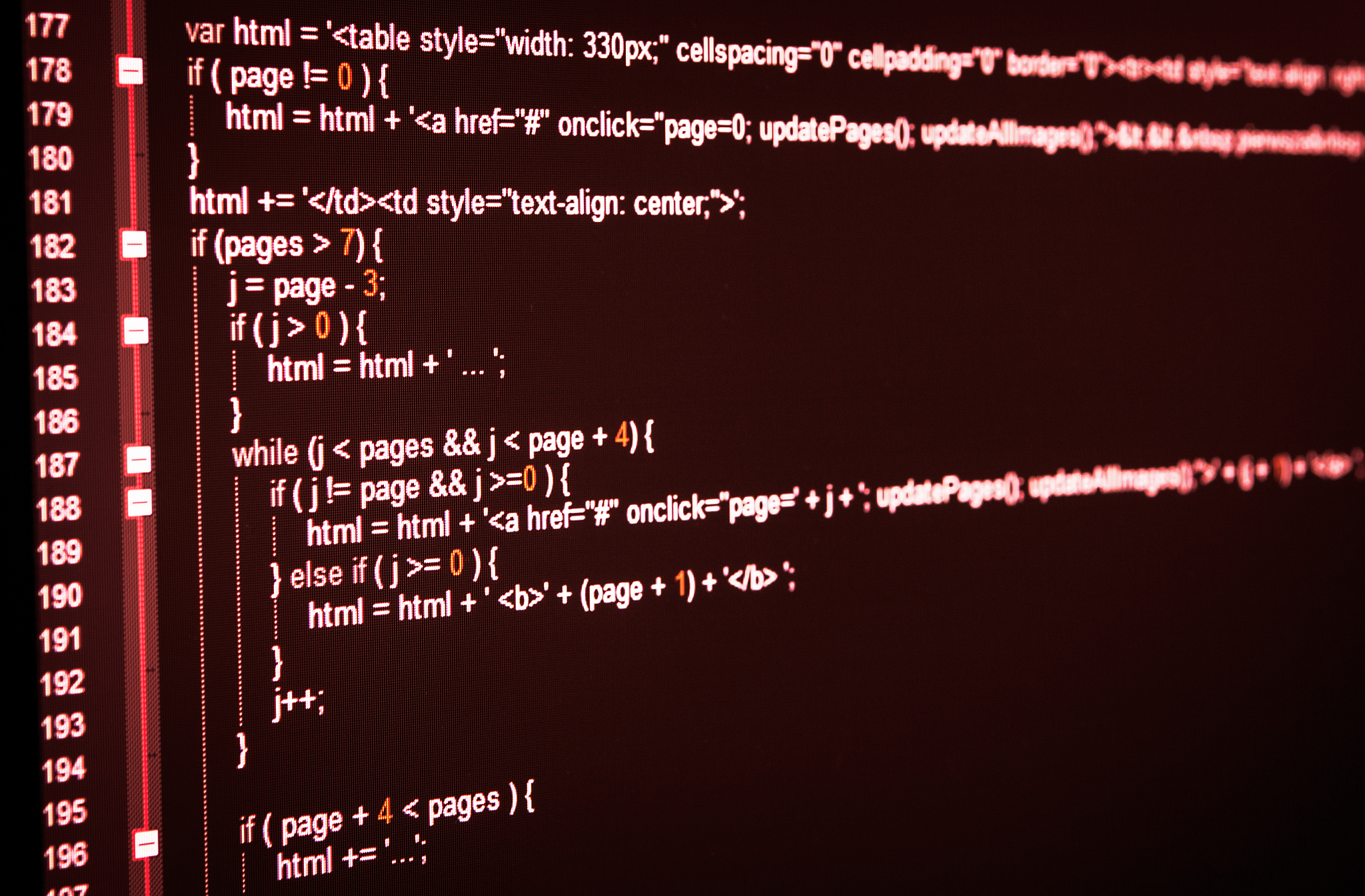

处理下一页:如果需要爬取多个页面,可以通过编写循环或递归的方式,自动处理下一页的链接,实现自动化爬取。

Python爬虫技术的应用非常广泛,可以用于获取各种类型的数据,如新闻、电影、股票、天气、商品信息等。它在数据分析、机器学习、人工智能等领域也扮演着重要的角色。

原文地址: https://www.cveoy.top/t/topic/lNpf 著作权归作者所有。请勿转载和采集!