怎么写爬虫代码

编写爬虫代码的基本步骤如下:

-

导入相关的库:通常使用的库有 requests、beautifulsoup、selenium 等。导入所需的库以便使用其提供的功能。

-

发送请求获取网页内容:使用 requests 库发送 HTTP 请求,获取网页的 HTML 内容。

-

解析网页内容:使用 beautifulsoup 库或其他 HTML 解析库对网页内容进行解析,提取所需的数据。

-

处理数据:根据需求对提取到的数据进行处理,如清洗、整理、存储等。

-

循环遍历:如果需要爬取多个页面,可以使用循环遍历的方式,不断发送请求、解析内容,并处理数据。

-

防止被封禁:为了避免被网站封禁,可以设置请求头信息、使用代理 IP、限制请求频率等措施。

-

异常处理:在爬虫过程中,可能会遇到各种异常情况,如网络连接错误、网页解析错误等,需要使用异常处理机制来处理这些异常情况。

-

存储数据:将处理后的数据存储到适当的位置,如数据库、文本文件、Excel 表格等。

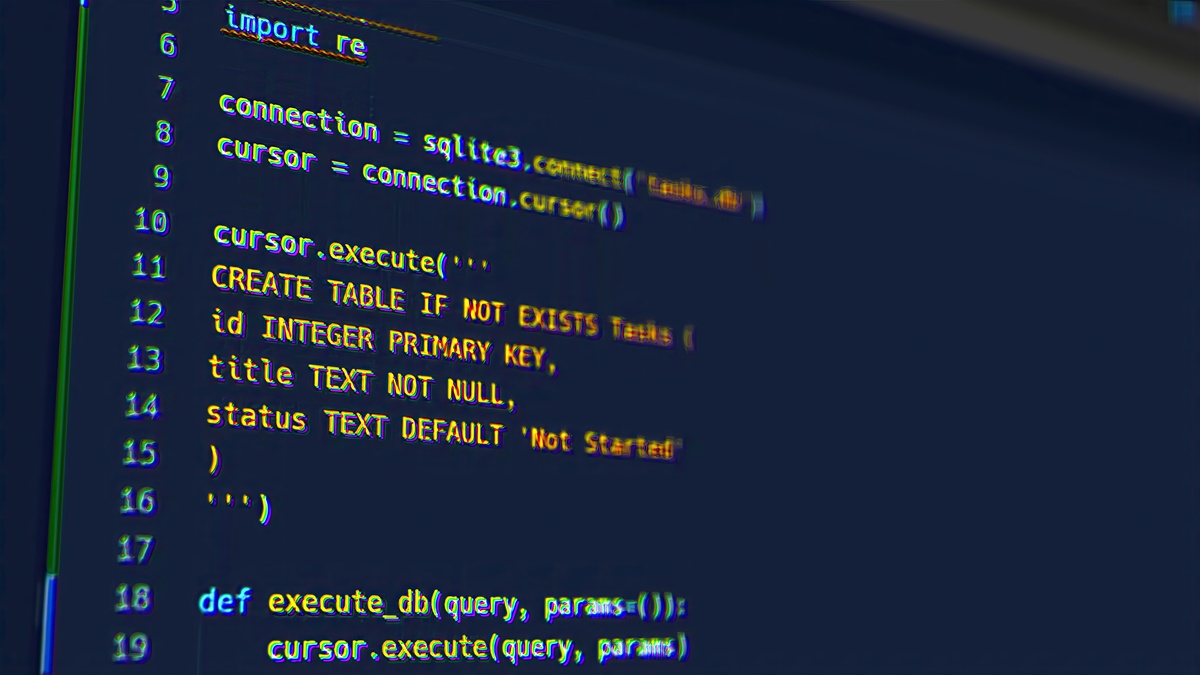

以下是一个简单的示例代码,用于爬取某个网站的文章标题和链接:

import requests

from bs4 import BeautifulSoup

# 发送请求获取网页内容

url = 'https://example.com'

response = requests.get(url)

html = response.text

# 解析网页内容

soup = BeautifulSoup(html, 'html.parser')

articles = soup.find_all('article')

# 处理数据

for article in articles:

title = article.find('h2').text

link = article.find('a')['href']

print(title, link)

# 防止被封禁和异常处理

# ...

# 存储数据

# ...

请注意,爬虫是一项合法但有一定风险的行为,需要遵守相关法律法规和网站的使用规定,避免对网站造成不必要的负担。在编写爬虫代码之前,建议先阅读目标网站的 robots.txt 文件和相关的使用条款,确保自己的行为合法合规

原文地址: https://www.cveoy.top/t/topic/iEwV 著作权归作者所有。请勿转载和采集!