在vscode中写函数找到数据湖中指定路径下的blob并对其进行加速查询最后将筛选出来的数据写回数据湖中文件

请注意,这个问题中涉及到的具体操作可能会因为使用的数据湖服务不同而有所不同。因此,下面的代码示例仅供参考。

首先,我们需要安装相应的Python库,以便在VSCode中使用。在终端中运行以下命令:

pip install azure-storage-blob azure-identity

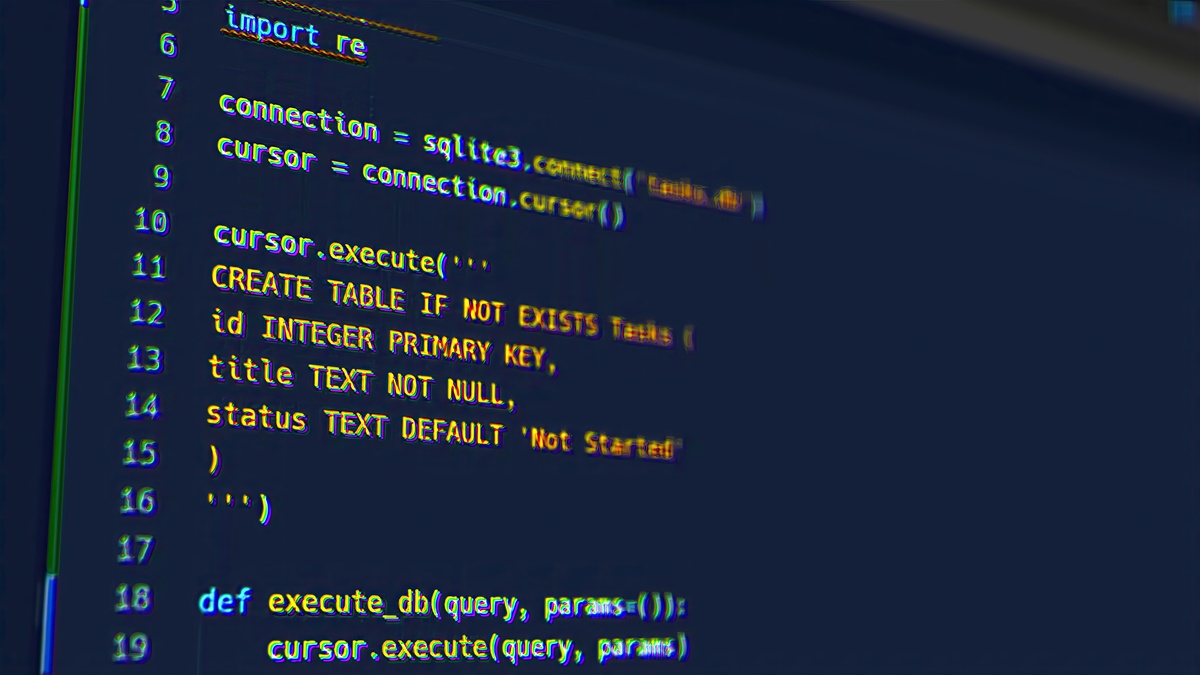

然后,我们可以编写一个函数来实现该操作。以下是一个示例函数,可以从指定路径下的blob中读取数据并对其进行筛选,然后将筛选出来的数据写回数据湖中文件:

from azure.identity import DefaultAzureCredential

from azure.storage.blob import BlobServiceClient

def filter_and_write_blob_data(account_url, container_name, blob_path, filter_condition, output_blob_path):

credential = DefaultAzureCredential()

blob_service_client = BlobServiceClient(account_url=account_url, credential=credential)

container_client = blob_service_client.get_container_client(container_name)

blob_client = container_client.get_blob_client(blob_path)

# Download blob data

blob_data = blob_client.download_blob().readall()

# Filter blob data

filtered_data = filter(filter_condition, blob_data)

# Upload filtered data to new blob

output_blob_client = container_client.get_blob_client(output_blob_path)

output_blob_client.upload_blob(filtered_data, overwrite=True)

在这个函数中,我们首先使用BlobServiceClient类来连接到指定的数据湖存储库。然后,我们使用get_container_client方法获取指定容器的客户端对象,并使用get_blob_client方法获取要筛选的blob的客户端对象。我们使用download_blob方法来下载blob数据,并使用readall方法将其读入到一个字节数组中。

接下来,我们使用filter函数来对blob数据进行筛选。filter_condition参数是一个函数,用于确定哪些数据应该被保留。例如,如果我们想要保留所有数字大于5的数据,我们可以使用以下函数:

def filter_condition(data):

return int(data) > 5

然后,我们将筛选出来的数据上传到一个新的blob中,使用get_blob_client方法获取目标blob的客户端对象,并使用upload_blob方法将数据写入到该blob中。

以上就是一个简单的函数,可以从数据湖中读取指定路径下的blob,并对其进行加速查询,最后将筛选出来的数据写回数据湖中文件

原文地址: https://www.cveoy.top/t/topic/hlhg 著作权归作者所有。请勿转载和采集!