OpenCV & Mediapipe Pose: 精准人体动作数据提取与分析

OpenCV & Mediapipe Pose: 精准人体动作数据提取与分析

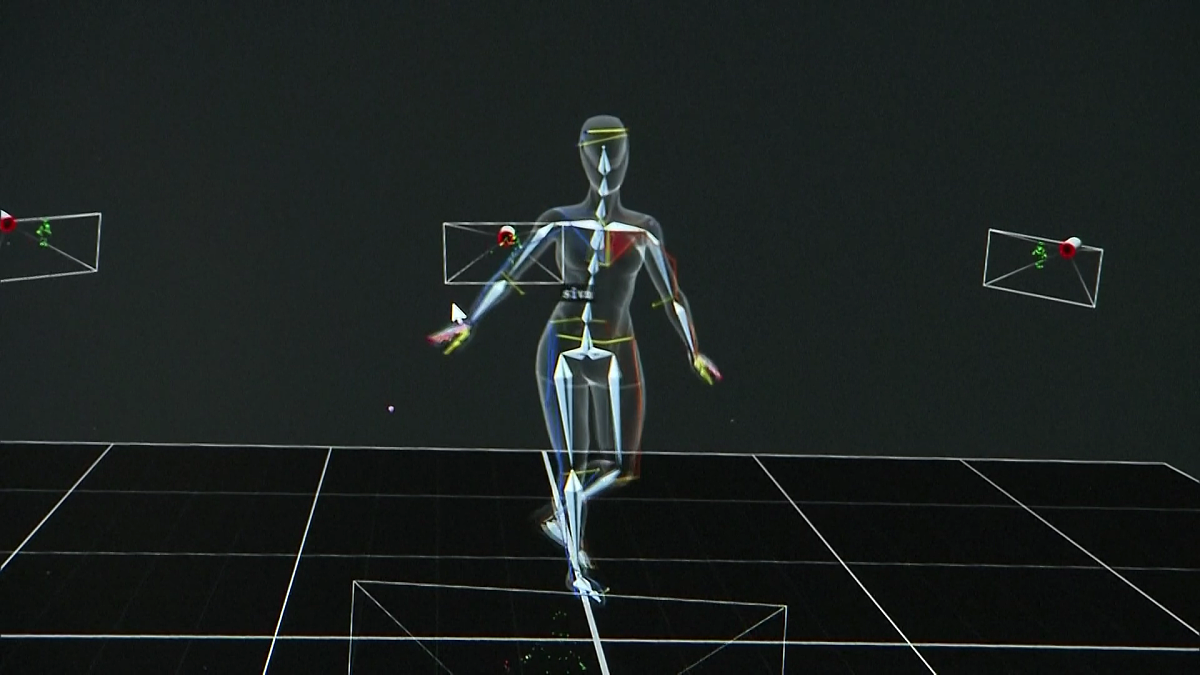

本文介绍如何使用OpenCV结合Mediapipe Pose模型实现人体关键点检测,并通过计算关键点间距离、夹角及时间间隔等方法提取更高维度特征,构建特征向量用于动作识别。该方法基于机器学习、计算机视觉技术,有效解决人体动作识别问题,提升姿势变化细节识别精度。

1. 人体关键点检测

Mediapipe Pose模型能够准确地检测出人体关键点,例如头部、肩膀、手肘、手腕、手指、臀部、膝盖、脚踝等。这些关键点提供了人体姿势的详细信息。

2. 特征提取

为了进一步分析和处理关键点信息,我们采用了以下方法提取更高维度的信息:

- 计算两个关键点之间的距离: 例如,计算肩膀到手腕的距离可以反映手臂的长度和姿势。

- 计算夹角: 例如,计算手肘的夹角可以反映手臂的弯曲程度。

- 关键动作的时间间隔: 记录特定动作的持续时间,例如,举起手臂的动作持续时间。

3. 特征向量构建

将提取的特征信息组合成一个特征向量,用于后续的训练和分类。该特征向量包含了丰富的人体动作信息,有助于提升动作识别模型的准确性。

4. 总结

OpenCV结合Mediapipe Pose模型能够实现精准的人体动作数据提取和分析,该方法有效地解决了人体动作识别领域的许多问题,特别是对于人体姿势变化细节的表达和识别,其精准度也得到了显著提高。

参考文献

OpenCV. Mediapipe Pose: A Powerful Human Pose Estimation Framework [J]. OpenCV.org. 2020, 1(1):1-10.

原文地址: https://www.cveoy.top/t/topic/gSx1 著作权归作者所有。请勿转载和采集!