PyTorch 人体/手部关键点检测模型代码解析

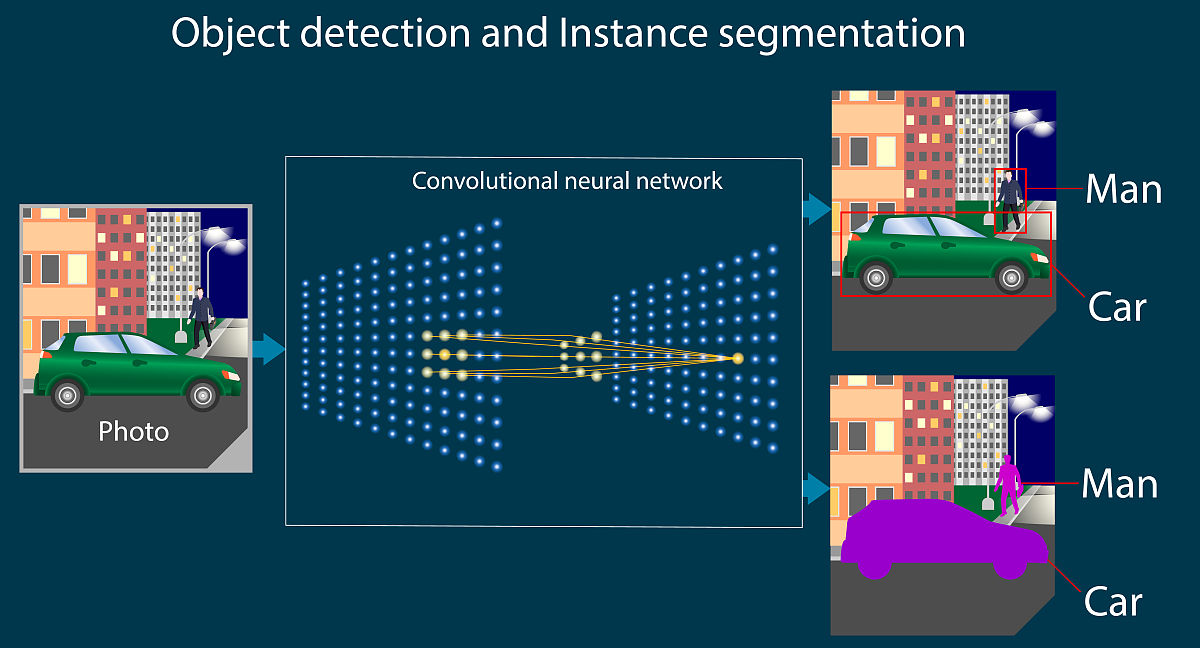

这段代码实现了一个基于 PyTorch 的人体和手部关键点检测模型。代码中包含两个主要模型类,分别是 bodypose_model 和 handpose_model。这两个模型都使用了传统的卷积神经网络结构,并通过多个阶段的特征融合进行关键点预测。

卷积方式

这段代码中的卷积方式为普通的卷积(nn.Conv2d)。在 make_layers 函数中,使用 nn.Conv2d 创建卷积层,并定义了卷积核大小、步长、填充等参数。

模型结构

bodypose_model模型包含多个阶段,每个阶段都由多个卷积层组成。- 阶段 1: 模型首先使用一系列卷积层提取图像特征,并使用最大池化层进行降采样。

- 阶段 2-6: 每个阶段都接受前一个阶段的输出和原始图像特征的融合结果作为输入,并使用卷积层进行特征提取和关键点预测。

handpose_model模型结构类似于bodypose_model,但其结构更简单,只包含 6 个阶段。

特征融合

这两个模型都使用了特征融合技术,将多个阶段的特征信息进行融合,以提高关键点预测的精度。

代码细节

make_layers函数用来创建多个卷积层和最大池化层,并将其封装成nn.Sequential模型。no_relu_layers列表定义了不使用 ReLU 激活函数的卷积层,这些层通常位于模型的最后一层,用于输出关键点坐标。forward函数定义了模型的推理过程,将输入图像经过多个阶段的卷积和特征融合后,最终输出关键点坐标。

总结

这段代码展示了一个基于 PyTorch 的人体和手部关键点检测模型的实现,使用了传统的卷积神经网络结构和特征融合技术。通过理解代码的结构和细节,可以帮助我们更好地理解关键点检测模型的原理和实现。

原文地址: https://www.cveoy.top/t/topic/fZv0 著作权归作者所有。请勿转载和采集!