KNN 分类算法详解:原理、步骤及优缺点

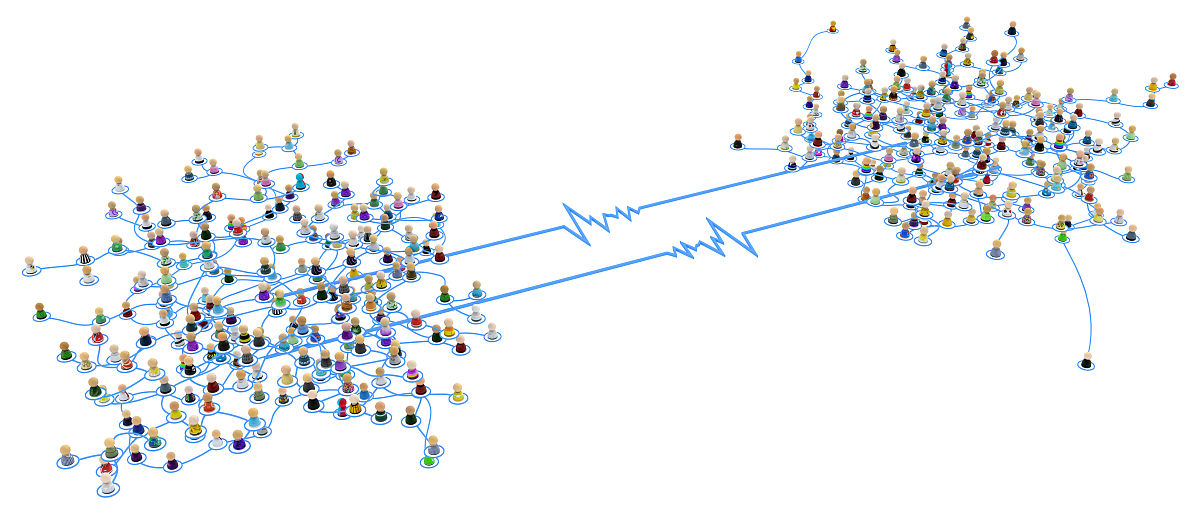

K最近邻 (K-Nearest Neighbor,KNN) 分类算法是一种基于实例的学习方法,它通过计算待分类样本与已知类别样本之间的距离,选取距离最近的 K 个样本作为邻居,然后根据邻居的类别进行分类。

KNN 算法的基本思想是:如果一个样本在特征空间中的 K 个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。

KNN 分类算法的步骤如下:

-

计算测试样本与训练样本之间的距离(欧氏距离、曼哈顿距离等);

-

选取距离最近的 K 个样本作为邻居;

-

根据邻居的类别进行投票,将测试样本分类为票数最多的类别;

-

返回分类结果。

KNN 算法的优点是简单易懂,适用于多分类问题和非线性分类问题;缺点是需要存储全部训练数据,计算时间复杂度高,对于高维数据会出现'维数灾难'。

原文地址: http://www.cveoy.top/t/topic/fZh3 著作权归作者所有。请勿转载和采集!