线性回归 vs 非线性回归: 5大区别详解及适用场景分析

线性回归 vs 非线性回归: 5大区别详解及适用场景分析

线性回归和非线性回归是统计学中两种常用的回归分析方法,用于建立自变量和因变量之间的关系,并进行预测。 虽然目标相似,但这两种方法在建模和适用范围上存在显著差异。 本文将从定义、假设、模型形式、参数估计、模型评估等方面详细介绍线性回归和非线性回归之间的区别,并分析其适用场景,帮助你选择合适的回归方法。

1. 定义

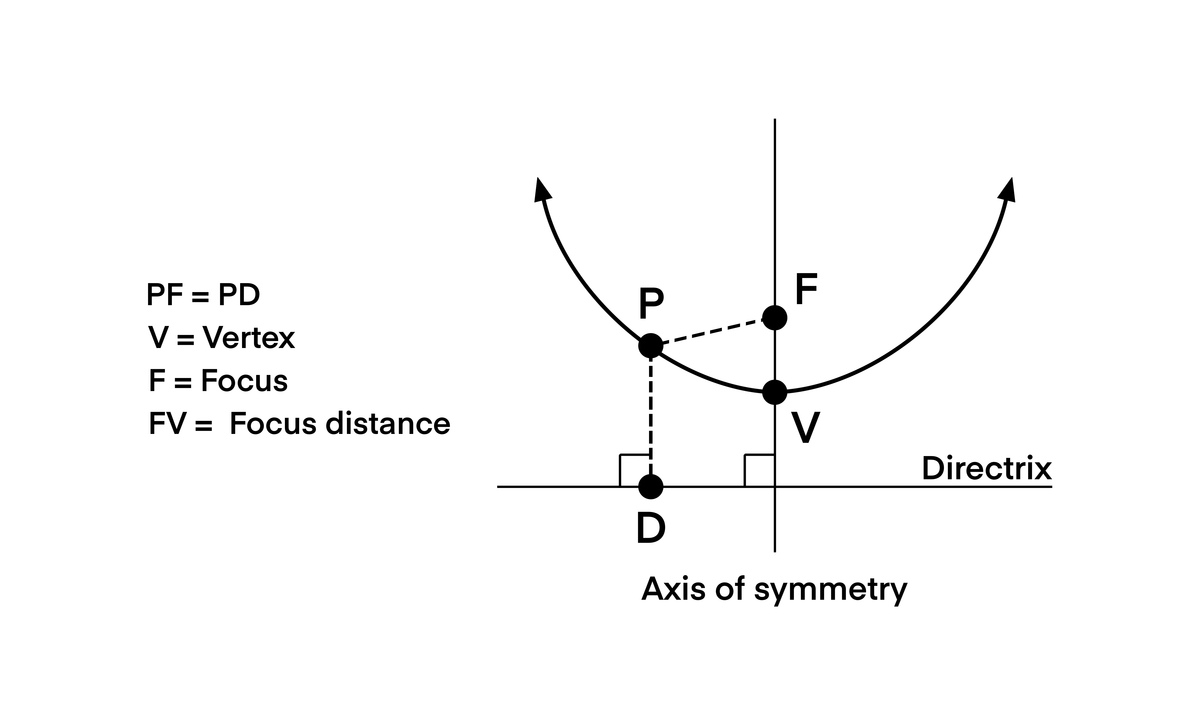

- 线性回归: 假设自变量和因变量之间存在线性关系,通过拟合一条直线或超平面来描述这种关系。* 非线性回归: 用于描述自变量和因变量之间非线性关系的回归方法,通过拟合曲线来描述这种关系,例如多项式曲线、指数曲线等。

2. 假设

- 线性回归: * 自变量和因变量之间存在线性关系。 * 误差项服从正态分布,且具有相同的方差(同方差性)和独立性。* 非线性回归: 对自变量和因变量之间的关系没有具体的假设,只要存在非线性关系,就可以使用非线性回归进行建模。

3. 模型形式

- 线性回归: Y = β0 + β1X1 + β2X2 + ... + βnXn + ε * Y: 因变量 * X1, X2, ..., Xn: 自变量 * β0, β1, β2, ..., βn: 回归系数 * ε: 误差项 非线性回归: 可以是任意的非线性函数形式,例如: * 多项式回归: Y = β0 + β1X + β2X^2 + ... + βnX^n + ε * 指数回归: Y = β0 * exp(β1X) + ε * 对数回归: Y = β0 + β1*ln(X) + ε

4. 参数估计

- 线性回归: 通常使用最小二乘法 (OLS) 估计回归系数。 OLS 的目标是找到使残差平方和最小化的回归系数。* 非线性回归: 通常使用非线性最小二乘法或非线性最大似然法估计回归系数。

5. 模型评估

- 线性回归: * R平方: 表示模型解释的因变量变异的比例。 * 调整 R平方: 考虑模型中自变量数量的 R平方版本。 * F 统计量: 检验模型的整体显著性。 * 残差分析: 用于检验线性回归模型的假设。* 非线性回归: * 拟合优度指标: 例如 R平方。 * AIC (Akaike 信息准则) 和 BIC (贝叶斯信息准则): 用于比较不同的非线性模型,并选择拟合优度高且复杂度低的模型。

线性回归和非线性回归的适用场景

- 线性回归: 适用于自变量和因变量之间存在线性关系的情况,例如商品价格与销量、广告投入与销售额等。* 非线性回归: 适用于自变量和因变量之间存在非线性关系的情况,例如人口增长、疾病传播、股票价格波动等。

总结:

线性回归和非线性回归是两种重要的回归分析方法,选择哪种方法取决于数据的具体情况和研究目的。 当自变量和因变量之间存在线性关系时,线性回归是更简单的选择。 当自变量和因变量之间存在非线性关系时,非线性回归可以提供更准确的模型。

原文地址: https://www.cveoy.top/t/topic/fAIU 著作权归作者所有。请勿转载和采集!