1*1卷积核PK全连接神经网络: 区别、优缺点及应用场景深度解析

1*1卷积核PK全连接神经网络: 区别、优缺点及应用场景深度解析

深度学习领域中,网络结构的设计对模型性能至关重要。1*1卷积核和全连接神经网络是两种常见的神经网络结构,它们在特征提取、参数数量、计算效率等方面各有千秋。本文将深入浅出地解析它们之间的区别、优缺点以及应用场景,帮助您更好地理解和选择合适的网络结构。

一、概念阐述

1. 1*1卷积核: 作为卷积神经网络中的一种特殊卷积核,1*1卷积核的尺寸最小,只包含一个参数。别看它小,却能在不改变输入数据尺寸的情况下,对不同通道的特征进行融合,实现特征提取和降维。

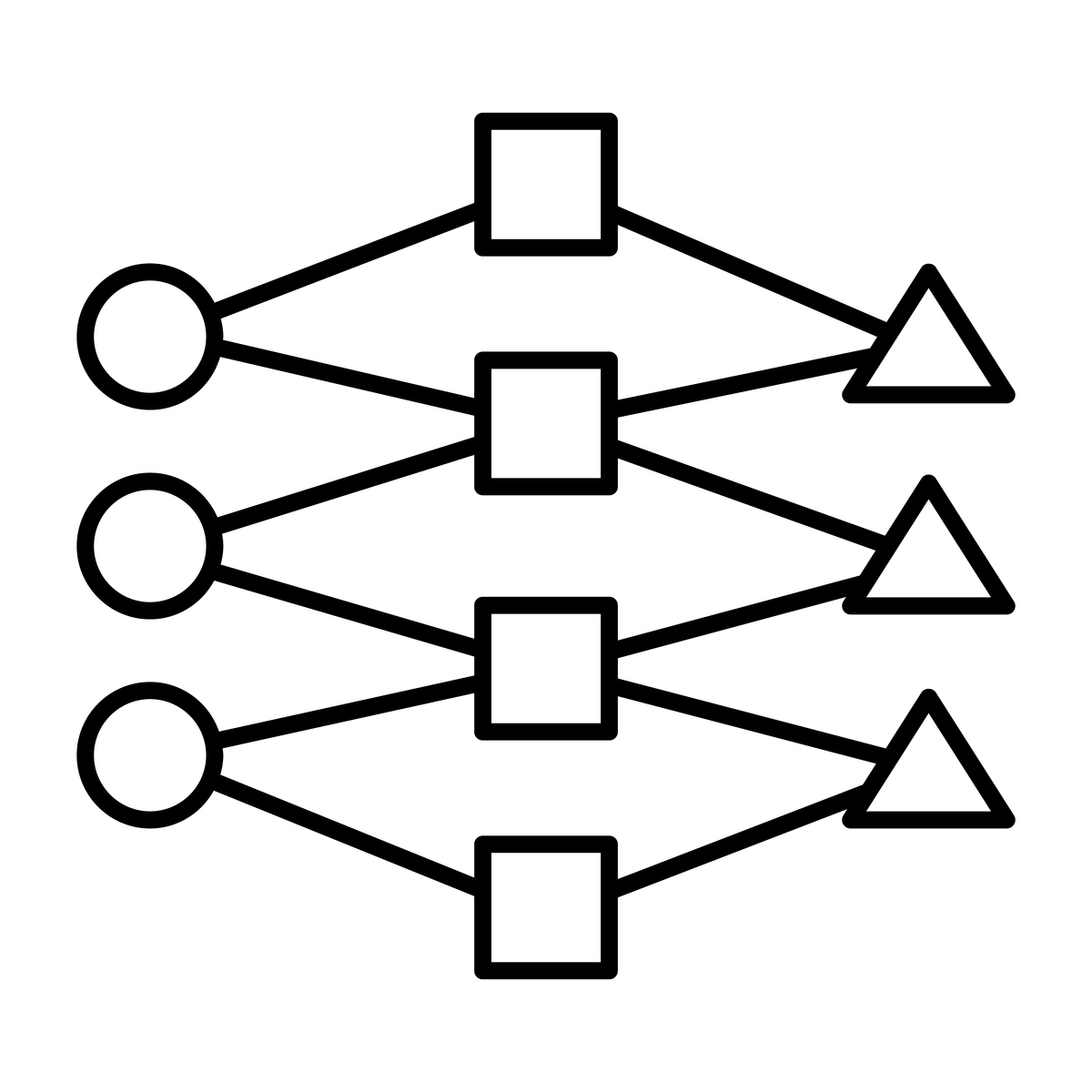

2. 全连接神经网络: 顾名思义,全连接神经网络中每个神经元都与前一层的所有神经元相连。这种结构能够学习输入数据的全局特征,但同时也带来了参数量大、计算效率低的问题。

二、作用机制

1. 1*1卷积核: 主要用于以下两个方面:

- 特征降维: 通过控制输出通道数,11卷积核可以减少特征图的通道数,从而降低计算复杂度,提升模型效率。 特征融合: 1*1卷积核能够融合不同通道的特征信息,增强网络的表达能力,提取更丰富的特征表示。

2. 全连接神经网络: 主要用于对输入数据进行分类或回归预测。它能够学习输入数据的全局特征,并将这些特征映射到相应的类别或数值。

三、区别剖析

| 特征 | 1*1卷积核 | 全连接神经网络 || ----------- | -------------------------------------------------------------- | ---------------------------------------------- || 参数数量 | 少,仅包含一个参数 | 多,每个神经元都需要学习一个权重参数 || 计算效率 | 高,参数量少,计算速度快 | 低,参数量大,计算速度慢 || 特征提取 | 局部特征提取,能够融合不同通道信息,实现跨通道的特征交互 | 全局特征提取,能够学习输入数据的整体特征 || 应用场景 | 卷积神经网络中,用于特征降维、特征融合,如GoogleNet、ResNet等 | 分类、回归任务,如AlexNet、VGG等 |

四、优缺点比较

1. 1*1卷积核

- 优点: 参数量少、计算效率高、能够进行特征降维和融合。* 缺点: 局部特征提取能力较弱,难以捕捉全局信息。

2. 全连接神经网络

- 优点: 能够学习输入数据的全局特征,表达能力强。* 缺点: 参数量大、计算效率低、容易出现过拟合现象。

五、应用场景

1. 1*1卷积核: 广泛应用于各种卷积神经网络模型中,例如:

- GoogleNet: 使用11卷积核进行特征降维,减少计算量,构建更深的网络结构。 ResNet: 使用1*1卷积核进行特征融合,提高网络的表达能力,缓解梯度消失问题。

2. 全连接神经网络: 主要应用于传统的图像分类和回归任务,例如:

- AlexNet: 使用全连接神经网络进行图像分类,取得了当时ImageNet比赛的冠军。* VGG: 使用更深的全连接神经网络结构,进一步提升了图像分类的准确率。

六、总结

1*1卷积核和全连接神经网络是深度学习中两种重要的网络结构,它们在特征提取、参数数量、计算效率等方面各有优劣。在实际应用中,我们需要根据具体的任务需求,选择合适的网络结构,才能构建出性能优异的深度学习模型。

原文地址: https://www.cveoy.top/t/topic/f2tN 著作权归作者所有。请勿转载和采集!