使用 MediaPipe 生成动作数据集并分析骨骼角度

这段代码用于生成一个包含各种动作图片及其对应骨骼角度的数据集。具体流程如下:

-

遍历不同动作的文件夹,每个文件夹中包含了该动作的多张图片。

-

遍历每张图片,读取图片并将其转换为RGB格式。

-

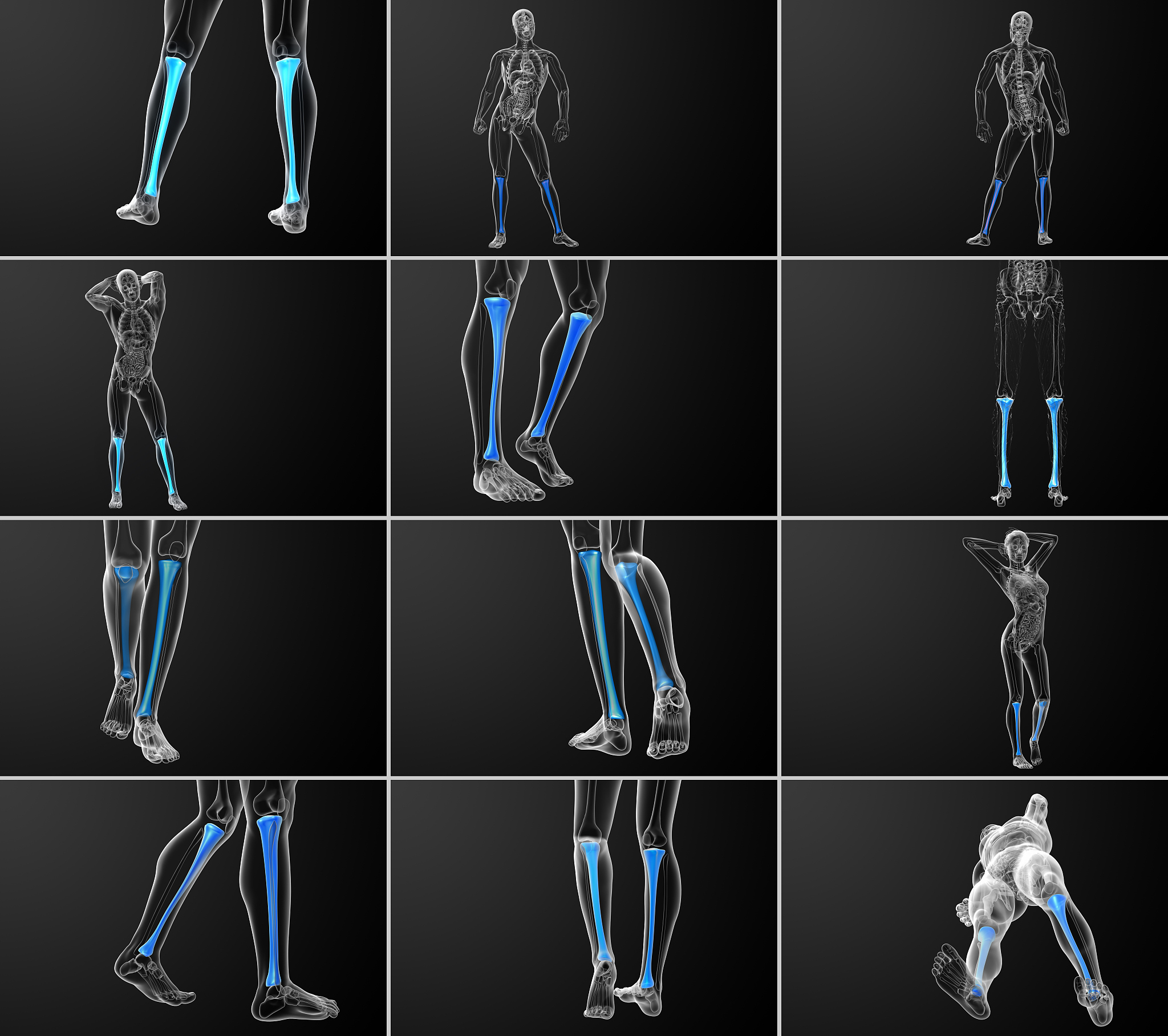

使用 MediaPipe 库中的 Pose 模型,提取出图片中的骨骼信息。

-

根据骨骼信息,计算出腿与右手的角度、左肩、左肘和左手腕的角度、左臀、左膝和左踝的角度、右臀、右膝和右踝的角度、右肩、右肘和右手腕的角度。

-

将这些角度添加到角度列表中,并在图像上绘制出骨骼。

-

将绘制好骨骼的图像保存到指定的文件夹中。

-

将角度列表保存为 CSV 文件,文件名为动作名称。

通过这个数据集,我们可以使用机器学习算法对不同的动作进行分类,从而实现动作识别的功能。

代码示例:

import mediapipe as mp

import cv2

import os

import pandas as pd

import math

# 定义保存骨骼角度的函数

def save_angles(angles_list, action_name, folder_name):

filename = f'{folder_name}_{action_name}.csv'

df = pd.DataFrame(angles_list, columns=['angle1', 'angle2', 'angle3', 'angle4', 'angle5'])

df.to_csv(filename, index=False)

print(f'{filename} saved successfully')

# 初始化 mediapipe

mp_drawing = mp.solutions.drawing_utils

mp_pose = mp.solutions.pose

# 遍历不同动作的文件夹

for folder_name in os.listdir('actions'):

# 创建一个空的角度列表

angles_list = []

# 遍历文件夹中的所有图片

for filename in os.listdir(f'actions/{folder_name}'):

# 读取图片

image = cv2.imread(f'actions/{folder_name}/{filename}')

# 将图片转换为 RGB 格式

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

# 处理图片,提取骨骼

with mp_pose.Pose(min_detection_confidence=0.5, min_tracking_confidence=0.5) as pose:

results = pose.process(image)

if results.pose_landmarks is None:

continue

right_knee = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_KNEE]

right_ankle = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_ANKLE]

right_wrist = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_WRIST]

# 获取左肩、左肘和左手腕关键点的信息

left_shoulder = results.pose_landmarks.landmark[mp_pose.PoseLandmark.LEFT_SHOULDER]

left_elbow = results.pose_landmarks.landmark[mp_pose.PoseLandmark.LEFT_ELBOW]

left_wrist = results.pose_landmarks.landmark[mp_pose.PoseLandmark.LEFT_WRIST]

# 获取右肩、右肘和右手腕关键点的信息

right_shoulder = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_SHOULDER]

right_elbow = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_ELBOW]

right_wrist = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_WRIST]

# 获取左臀、左膝和左踝关键点的信息

left_hip = results.pose_landmarks.landmark[mp_pose.PoseLandmark.LEFT_HIP]

left_knee = results.pose_landmarks.landmark[mp_pose.PoseLandmark.LEFT_KNEE]

left_ankle = results.pose_landmarks.landmark[mp_pose.PoseLandmark.LEFT_ANKLE]

# 获取右臀、右膝和右踝关键点的信息

right_hip = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_HIP]

right_knee = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_KNEE]

right_ankle = results.pose_landmarks.landmark[mp_pose.PoseLandmark.RIGHT_ANKLE]

# 计算腿与右手的角度

angle = math.degrees(math.atan2(right_wrist.y - right_ankle.y, right_wrist.x - right_ankle.x) -

math.atan2(right_knee.y - right_ankle.y, right_knee.x - right_ankle.x))

# 获取左肩、左肘和左手腕

angle1 = math.degrees(math.atan2(right_wrist.y - right_ankle.y, right_wrist.x - right_ankle.x) -

math.atan2(right_knee.y - right_ankle.y, right_knee.x - right_ankle.x))

# 获取左臀、左膝和左踝

angle_dl = math.degrees(math.atan2(left_ankle.y - left_knee.y, left_ankle.x - left_knee.x) -

math.atan2(left_hip.y - left_knee.y, left_hip.x - left_knee.x))

# 获取右臀、右膝和右踝

angle_dr = math.degrees(math.atan2(right_ankle.y - right_knee.y, right_ankle.x - right_knee.x) -

math.atan2(right_hip.y - right_knee.y, right_hip.x - right_knee.x))

# 获取右肩、右肘和右手腕

angle_tr = math.degrees(math.atan2(right_wrist.y - right_elbow.y, right_wrist.x - right_elbow.x) -

math.atan2(right_shoulder.y - right_elbow.y, right_shoulder.x - right_elbow.x))

# 将角度添加到角度列表中

angles_list.append([angle, angle1, angle_dl, angle_dr, angle_tr])

# 在图像上绘制骨骼

annotated_image = image.copy()

mp_drawing.draw_landmarks(annotated_image, results.pose_landmarks, mp_pose.POSE_CONNECTIONS)

# 保存绘制好骨骼的图像

cv2.imwrite(f'annotated_images/{filename}', cv2.cvtColor(annotated_image, cv2.COLOR_RGB2BGR))

# 将角度列表保存为 csv 文件

save_angles(angles_list, folder_name, 'dataset')

说明:

- 代码中的

actions文件夹应该包含不同动作的图片,每个文件夹对应一个动作。 - 代码会将绘制好骨骼的图片保存到

annotated_images文件夹中。 - 代码会将角度列表保存到

dataset文件夹中,每个 CSV 文件对应一个动作。

使用场景:

- 动作识别

- 姿势估计

- 人体行为分析

相关资源:

原文地址: http://www.cveoy.top/t/topic/gubD 著作权归作者所有。请勿转载和采集!