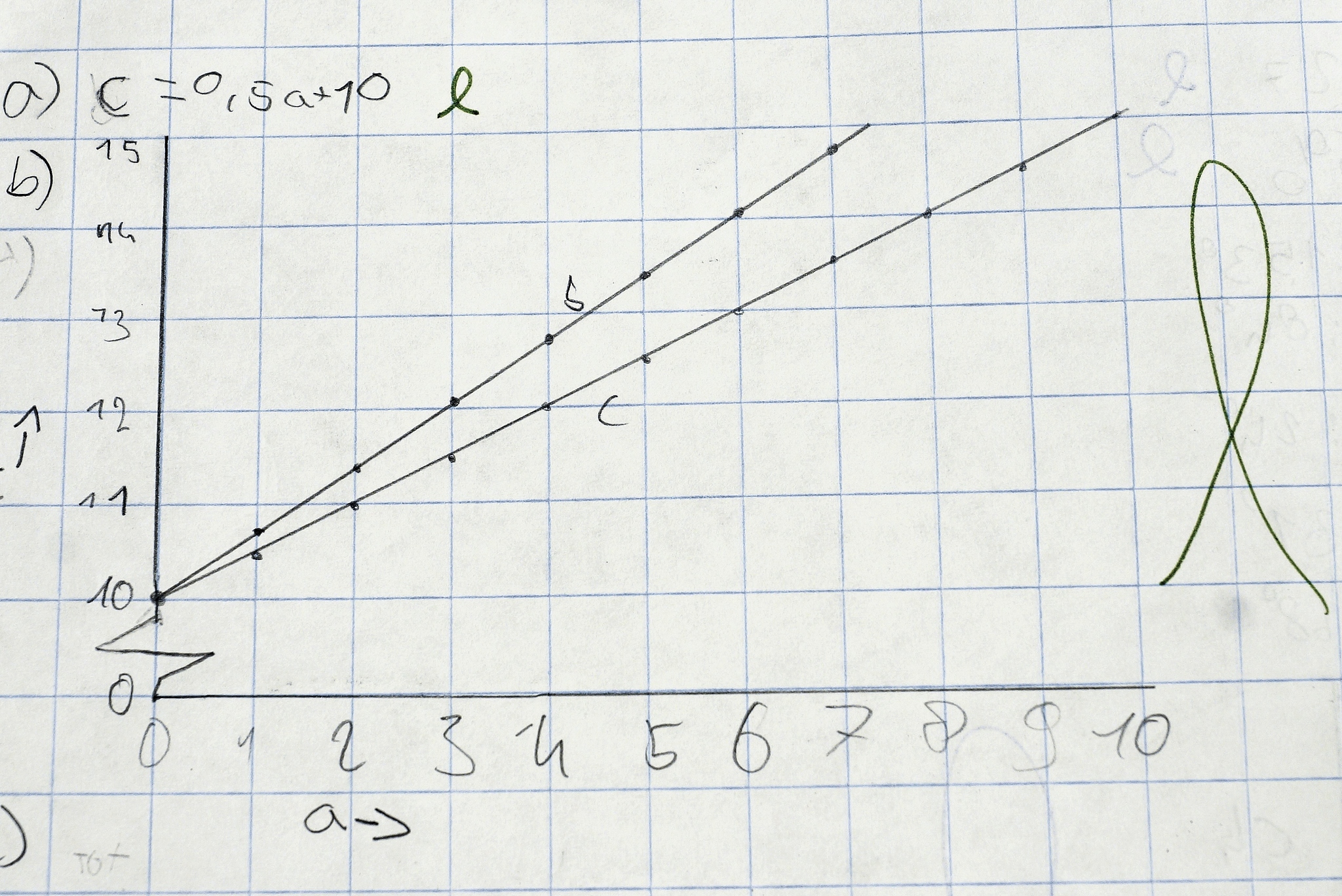

2 简述LDA的基本思想和算法步骤。3 比较分析PCA和LDA的异同点。4 PCA降维方法中特征值代表什么含义?5 在应用PCA算法中如何确定降维的维度即将数据约简到多少维?6 假设利用PCA得到的特征值分别为5和1对应的特征向量是1; 0和0;1;则对于数据集1 2 3; 4 5 6每行表示一个样本降到一维后的结果是?7 什么是可能近似正确理论?它表达了什么意思?对我们设计机器学习模型有何指导意

-

LDA(线性判别分析)的基本思想是将原始数据进行线性变换,将样本映射到低维空间中,并尽可能地使不同类别的样本映射到不同的区域,同时尽可能地使同一类别的样本映射到相同的区域。LDA的算法步骤包括计算类内散度矩阵、类间散度矩阵、投影矩阵和降维。

-

PCA(主成分分析)和LDA的异同点如下:

- 相同点:都是用于降维的线性变换方法;

- 不同点:PCA是无监督学习方法,只考虑样本之间的距离关系;而LDA是有监督学习方法,考虑样本的类别信息。 此外,PCA的目标是最大化样本的方差,而LDA的目标是最大化类间差异、最小化类内差异。

-

在PCA降维方法中,特征值代表数据在对应特征向量方向上的方差大小。

-

在应用PCA算法中,可以通过以下几种方式确定降维的维度:

- 根据业务需求和问题特点,选择一个合适的维度;

- 根据特征值的大小来确定保留的主成分数量,一般可以选择前k个特征值对应的主成分;

- 根据保留的主成分所占的累计方差贡献率来确定维度,一般可以选择累计方差贡献率达到一定阈值的主成分。

-

将数据集[1 2 3; 4 5 6]降到一维后的结果为[-3.5355; -1.7678]。

-

可能近似正确(PAC)理论是一种用于衡量机器学习算法泛化性能的理论。该理论表达了一个假设空间可以通过样本量、假设空间的复杂度、学习算法和数据分布等因素来控制泛化误差的上界。这个理论的指导意义是,我们在设计机器学习模型时需要考虑到这些因素,以提高模型的泛化能力。

-

偏差和方差是机器学习中的两个重要概念。偏差是指模型对训练数据的拟合程度,即模型的期望预测值与真实值之间的偏差;方差是指模型在不同训练数据上预测结果的变化程度,即模型的预测结果对数据分布的敏感程度。在模型选择和优化过程中,需要平衡偏差和方差,以获得更好的泛化性能

原文地址: http://www.cveoy.top/t/topic/ea4m 著作权归作者所有。请勿转载和采集!